뼈 두개골 내에 싸여있는 3 파운드의 조직인 우리의 뇌가 감각에서 인식을 만드는 방법은 오랜 미스터리입니다. 풍부한 증거와 수십 년간의 지속적인 연구에 따르면 뇌는 주변을 주변을 인식하기 위해 직소 퍼즐을 만들어내는 것처럼 감각 정보를 단순히 조립할 수 없다고 제안합니다. 이것은 들어오는 정보가 시끄럽고 모호한 경우에도 뇌가 우리 눈에 들어가는 빛을 기반으로 장면을 구성 할 수 있다는 사실에 의해 뒷받침됩니다.

결과적으로, 많은 신경 과학자들은 뇌를“예측 기계”로 관찰하고 있습니다. 예측 처리를 통해 뇌는 세계에 대한 사전 지식을 사용하여 들어오는 감각 정보의 원인에 대한 추론을 만들거나 가설을 생성합니다. 감각적 입력 자체가 아닌 그 가설은 우리의 마음의 눈에 인식을 야기합니다. 입력이 모호할수록 사전 지식에 대한 의존도가 커집니다.

네덜란드의 Radboud University의 예측 뇌 실험실의 신경 과학자 인 Floris de Lange는“예측 처리 프레임 워크의 아름다움은 매우 큰 다른 시스템에서 많은 다른 현상을 설명 할 수있는 능력이 너무 커질 수 있다는 것입니다.

그러나이 아이디어에 대한 신경 과학적 증거가 증가하는 것은 주로 정황이었으며 대체 설명에 개방되어 있습니다. Radboud University의 Tim Kietzmann은“인간의인지 신경 과학과 신경 이미징을 조사한다면, 많은 증거가 있지만, 매우 중요한 증거가 있지만, 기계 학습 및 신경 과학의 학제 간 영역에 관한 연구가 있습니다.

.따라서 연구자들은 예측 뇌에 대한 아이디어를 이해하고 테스트하기 위해 계산 모델로 전환하고 있습니다. 계산 신경 과학자들은 생물학적 뉴런의 행동에서 영감을 얻은 설계로 인공 신경망을 구축하여 들어오는 정보에 대한 예측을 배우는 법을 배웠습니다. 이 모델은 실제 두뇌의 능력을 모방하는 것처럼 보이는 몇 가지 어수선한 능력을 보여줍니다. 이 모델에 대한 일부 실험은 심지어 뇌가 에너지 제약을 충족시키기 위해 예측 기계로 진화해야한다고 힌트를 힌트합니다.

그리고 계산 모델이 확산됨에 따라, 살아있는 동물을 연구하는 신경 과학자들은 또한 뇌가 감각 입력의 원인을 유추하는 것을 배우는 것을 더 확신하게되고있다. 뇌가 어떻게 이루어지는 지에 대한 정확한 세부 사항은 흐릿하게 남아 있지만, 넓은 브러시 스트로크가 더 명확 해지고 있습니다.

인식의 무의식적 추론

예측 처리 처리는 처음에는 지각을위한 반 직관적으로 복잡한 메커니즘처럼 보일 수 있지만, 다른 설명이 원했던 것처럼 보였기 때문에 과학자들의 오랜 역사가 있습니다. 천년 전, 무슬림 아랍 천문학 자이자 수학자 하산 이븐 알-헤이 햄 (Hasan Ibn Al-Haytham)은 Optics 에서 그 형태를 강조했다. 비전의 다양한 측면을 설명합니다. 독일의 물리학 자이자 의사 Hermann von Helmholtz가 뇌가 입력에서“하향적”을 구성하기보다는 들어오는 감각 입력의 외부 원인을 유추한다고 주장했을 때, 1860 년대 에이 아이디어는 힘을 모았습니다.

.Helmholtz는이“무의식적 추론”이라는 개념을 설명하기 위해 이미지가 여러 가지 방식으로 인식 될 수있는 이중 안정 또는 다중 안정적인 인식을 설명하기 위해 설명했다. 예를 들어, 우리가 오리 나 토끼로 인식 할 수있는 잘 알려진 모호한 이미지에서는 발생합니다. 우리의 인식은 두 동물 이미지 사이를 계속 뒤집습니다. 그러한 경우, Helmholtz는 망막에서 형성되는 이미지가 변하지 않기 때문에 감각 데이터의 원인에 대한 하향식 추론의 무의식적 인 과정의 결과가되어야한다고 주장했다.

.20 세기 동안인지 심리학자들은 인식이 상향식 감각과 하향식 개념적 입력을 모두 이끌어내는 적극적인 구성 과정이라는 사례를 계속 구축했습니다. 리차드 랭턴 그레고리 (Richard Langton Gregory) 후반의 영향력있는 1980 년 논문 인“가설로서의 인식”에서이 노력이 끝났다. 한편, 컴퓨터 비전 과학자들은 상향식 재구성을 사용하여 컴퓨터가 내부 "생성"모델없이 참조 할 수 있도록 노력하는 노력에 우연히 발견했습니다.

University College London의 계산 신경 과학자 인 Karl Friston은“생성 모델없이 데이터를 이해하려고 시도하는 것은 실패에 처한 것입니다. 데이터의 패턴에 대한 진술을하는 것입니다.

그러나 예측 처리에 대한 수용이 증가했지만 뇌에서 어떻게 구현 될 수 있는지에 대한 의문이 남아있었습니다. 예측 코딩이라는 인기있는 모델 중 하나는 뇌의 정보 처리 수준의 계층 구조를 주장합니다. 가장 높은 수준은 가장 추상적 인 높은 수준의 지식을 나타냅니다 (예 :그림자의 뱀에 대한 인식). 이 층은 신호를 아래쪽으로 보내어 아래 층의 신경 활동을 예상하는 예측을합니다. 하부 층은 실제 활동을 위의 예측과 비교합니다. 불일치가 있으면 레이어는 위쪽으로 흐르는 오류 신호를 생성하여 더 높은 계층이 내부 표현을 업데이트 할 수 있습니다.

이 프로세스는 각 연속 층 쌍에 대해 동시에 발생하며, 실제 감각 입력을받는 병이 많은 층까지. 세계로부터받은 것과 예상되는 것 사이의 불일치는 계층 구조를 잔돌로 두는 오류 신호가 발생합니다. 가장 높은 층은 결국 가설을 업데이트합니다.

De Lange는“일반적으로 예측 코딩에 대한 아이디어는 특히 피질에 적용될 때 뇌에 기본적으로 두 가지 뉴런의 개체수가 있다는 것입니다.

1999 년, 컴퓨터 과학자 인 Rajesh Rao와 Dana Ballard (Salk Institute for Biological Studies와 Rochester University)는 예측 및 오류 수정을 위해 뉴런을 명시 적으로 가지고있는 예측 코딩의 강력한 계산 모델을 구축했습니다. 그들은 얼굴과 물체를 인식하는 계층 적으로 조직 된 지역으로 구성된 영장류 뇌의 시각적 처리 시스템에서 경로의 일부를 모델링했습니다. 그들은 모델이 영장류 시각 시스템의 특이한 행동을 되 찾을 수 있음을 보여 주었다.

그러나이 작업은 하나의 입력 계층, 하나의 출력 레이어 및 두 개의 숨겨진 계층이있는 현대 심해 신경망이 출현하기 전에 이루어졌습니다. 2012 년까지 신경 과학자들은 깊은 신경망을 사용하여 영장류 복부 시각 스트림을 모델링했습니다. 그러나 거의 모든 모델은 피드 포워드 네트워크로, 정보는 입력에서 출력으로 만 흐릅니다. De Lange는“뇌는 분명히 순전히 피드 포워드 기계가 아닙니다. "피드 포워드 [신호]만큼이나 많은 피드백이 있습니다."

따라서 신경 과학자들은 재발 신경 네트워크 (RNN)라고 불리는 다른 유형의 모델로 바뀌 었습니다. 뉴욕 시나이 산의 ICAHN 의과 대학의 계산 신경 과학자이자 조교수 인 Kanaka Rajan에 따르면, 뇌는 RNN을 사용하여 뇌 기능을 이해하는 Kanaka Rajan에 따르면 이들은 뇌를 모델링하기위한“이상적인 기질”을 만드는 특징을 가지고 있다고한다. RNN은 뉴런 사이의 피드 포워드 및 피드백 연결을 모두 가지고 있으며 입력과 무관 한 지속적인 진행중인 활동을 가지고 있습니다. Rajan은“본질적으로 영원히 영원히이 역학을 생산하는 능력은 이러한 네트워크에 교육을받을 수있는 능력을 제공하는 것입니다.”라고 Rajan은 말했습니다.

예측은 에너지 효율입니다

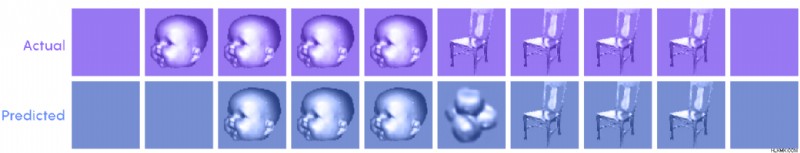

RNNS는 Harvard University의 William Lotter와 그의 박사 논문 고문 David Cox와 Gabriel Kreiman의 관심을 끌었습니다. 2016 년에 팀은 비디오 시퀀스에서 다음 프레임을 예측하는 법을 배운 RNN을 선보였습니다. 그들은 그것을 Prednet이라고 불렀습니다 (“나는 더 나은 것을 생각해 낼 창의성이 충분하지 않은 것에 대해 비난을받을 것입니다.”라고 Lotter는 말했습니다. 이 팀은 예측 코딩의 원리를 4 개의 계층의 계층으로 유지하기 위해 RNN을 설계했으며, 각 레이어는 아래 계층에서 예상되는 입력을 예측하고 불일치가있는 경우 오류 신호를 위로 보내는 것을 예측합니다.

.그런 다음 자동차에 장착 된 카메라에서 촬영 한 City Streets의 비디오에서 네트워크를 교육했습니다. Prednet은 비디오의 다음 프레임을 지속적으로 예측하는 법을 배웠습니다. Lotter는“실제로 작동하는지 몰랐습니다. “우리는 그것을 시도했고 그것이 실제로 예측을하는 것을 보았습니다. 그리고 그것은 꽤 시원했습니다.”

다음 단계는 프레드넷을 신경 과학에 연결하는 것이 었습니다. 작년 Nature Machine Intelligence , Lotter와 동료들은 Prednet이 간단한 피드 포워드 네트워크에서 복제하기 어려운 일부를 포함하여 예기치 않은 자극에 반응하여 원숭이 뇌에서 보이는 행동을 보여준다고보고했습니다.

Kietzmann은 Prednet에 대해“환상적인 작업입니다. 그러나 그는 Radboud의 Marcel van Gerven과 그들의 동료들은 더 기본적인 것을 쫓고있었습니다. Rao와 Ballard Model과 Prednet은 예측 및 오차 보정을 위해 인공 뉴런을 명시 적으로 통합하고 올바른 하향식 예측을 유발하여 오류 뉴런을 억제했습니다. 그러나 그것들이 명시 적으로 지정되지 않았다면 어떻게해야합니까? Kietzmann은“우리는이 모든 '베이킹'건축 적 제약 조건이 실제로 필요한지 또는 더 간단한 접근 방식으로 도망 칠 것인지 궁금했습니다.

Kietzmann과 Van Gerven에게 일어난 일은 신경 의사 소통이 에너지 적으로 비용이 많이 든다는 것입니다 (뇌는 신체에서 가장 에너지 집약적 인 기관입니다). 따라서 에너지를 보존해야 할 필요성은 유기체에서 진화하는 신경망의 행동을 제한 할 수 있습니다.

연구원들은 예측 코딩을위한 계산 메커니즘이 가능한 한 적은 에너지를 사용하여 작업을 수행 해야하는 RNN에서 나타날 수 있는지 확인하기로 결정했습니다. 그들은 네트워크의 인공 뉴런 사이의 중량이라고도하는 연결의 강점이 시냅스 전달의 대리 역할을 할 수 있다고 생각했다. 이는 생물학적 뉴런에서의 에너지 사용의 대부분을 설명하는 것입니다. Kietzmann은“인공 단위 사이의 무게를 줄이면 에너지가 적다는 것을 의미합니다. "우리는 이것을 시냅스 전송을 최소화하는 것으로 간주합니다."

그런 다음이 팀은 오름차순, 랩 어라운드 순서 (1234567890, 3456789012, 6789012345 등의 수많은 연속 숫자 시퀀스에 대해 RNN을 교육했습니다. 각 숫자는 28 x 28 픽셀 이미지 형태로 네트워크에 표시되었습니다. RNN은 시퀀스의 임의의 위치에서 시작하여 다음 자리가 무엇인지 예측할 수있는 내부 모델을 배웠습니다. 그러나 네트워크는 생물학적 신경계에서 낮은 수준의 신경 활동과 유사한 단위 사이의 가장 작은 가중치로이를 수행해야했습니다.

이러한 조건에서 RNN은 다음 숫자를 순서대로 예측하는 법을 배웠습니다. 인공 뉴런 중 일부는 예상 입력 모델을 나타내는 "예측 단위"역할을했습니다. 다른 뉴런은 예측 단위가 아직 다음 숫자를 올바르게 예상하는 법을 배우지 못했을 때 가장 활성화 된 "오류 단위"역할을했습니다. 예측 장치가 올바르게 시작되기 시작했을 때 이러한 오류 장치가 정복되었습니다. 결정적으로, 네트워크는 에너지 사용량을 최소화하도록 강요 되었기 때문에이 아키텍처에 도달했습니다. Kietzmann은“이것은 사람들이 일반적으로 시스템에 구축 한 일종의 억제를 배우는 법을 배웁니다. "우리의 시스템은 에너지 효율적인 일을하기 위해 박스 밖으로 나가는 일을합니다."

테이크 아웃은 에너지 사용량을 최소화하는 신경망이 일종의 예측 처리를 구현하게 될 것이라는 점입니다.

Rajan은 Kietzmann의 작품을“에너지 최소화와 같은 하향식 제약이 예측 코딩과 같은 특정 기능으로 간접적으로 이어질 수있는 방법에 대한 매우 깔끔한 예”라고 불렀습니다. RNN의 특정 오류 및 예측 장치의 출현이 네트워크 가장자리의 뉴런 만 입력을 받고 있다는 사실의 의도하지 않은 결과 일 수 있는지 궁금해했다. 입력이 네트워크 전체에 분포 된 경우,“내 무릎을 꿇고 추측하는 추측은 오류 단위와 예측 단위 간의 분리를 찾지 못할 것이지만 여전히 예측 활동을 찾을 수있을 것입니다.”라고 그녀는 말했습니다.

뇌 행동을위한 통일 프레임 워크

계산 연구의 이러한 통찰력이 결국 살아있는 뇌의 증거만이 뇌에서 예측 처리를 설득 할 수있는 것처럼 보일 수 있습니다. 이를 위해 McGill University와 Mila의 신경 과학자이자 컴퓨터 과학자 인 Blake Richards, 퀘벡 인공 지능 연구소 및 그의 동료들은 예기치 않은 사건에 대한 예측을 배우는 것이 뇌에서 볼 수있는 것에 대한 명확한 가설을 공식화했습니다.

.그들의 가설을 테스트하기 위해, 그들은 시애틀에있는 Allen Institute for Brain Science의 연구원들에게 돌았으며, 그는 뇌의 신경 활동을 모니터링하면서 마우스에 대한 실험을 수행했습니다. 뇌의 신피질에서 특정 피라미드 뉴런이 특히 중요하며, 이는 예측 처리에 해부학 적으로 적합한 것으로 생각됩니다. 그들은 근처 뉴런 (세포체에 입력을 통해)으로부터 국소 상향식 감각 신호와 더 먼 뉴런 (정점 수상 돌기를 통해)의 하향식 예측 신호를 모두받을 수 있습니다.

.마우스는 빛과 어두운 줄무늬로 구성된 많은 가보 패치 서열을 보여 주었다. 각 순서에서 4 개의 패치는 거의 동일한 방향을 가졌으며, 마우스는 그것을 기대하게되었습니다. Richards는“이 시퀀스를 보면서 지옥으로 지루해야했을 것입니다.”라고 Richards는 말했습니다. 그런 다음 연구원들은 예상치 못한 사건을 삽입했습니다. 네 번째 Gabor 패치는 무작위로 다른 방향으로 회전했습니다. 동물들은 처음에는 놀랐지 만 시간이 지남에 따라 놀라움의 요소도 기대하게되었습니다. 그동안 연구원들은 생쥐의 뇌에서의 활동을 관찰했습니다.

그들이 본 것은 많은 뉴런이 예상 및 예기치 않은 자극에 다르게 반응했다는 것이었다. 결정적으로,이 차이는 테스트 첫날에 국부적 인 상향식 신호에서 강력했지만, 2 일과 3 일 동안 쇠약 해졌다. 예측 처리의 맥락에서, 이것은 새로 형성된 하향식 기대치가 자극이 덜 놀라워지면서 들어오는 감각 정보에 대한 반응을 억제하기 시작했음을 시사했다.

.한편, 정점 수상 돌기에서 그 반대가 일어나고있었습니다. 예기치 않은 자극에 대한 반응의 차이는 시간이 지남에 따라 증가했습니다. 신경 회로는 다음 번에 더 나은 예측을하기 위해 놀라운 사건의 속성을 더 잘 표현하는 법을 배우는 것처럼 보였습니다.

Richards는“이 연구는 예측 학습 또는 예측 코딩과 같은 것이 신피질에서 일어나고 있다는 생각에 대한 추가 지원을 제공합니다.

뉴런 활동이나 동물의 행동에 대한 개별 관찰이 때때로 다른 뇌 모델에 의해 설명 될 수 있다는 것은 사실입니다. 예를 들어, 오류 단위의 억제로 해석되는 대신 동일한 입력에 대한 뉴런에서의 약한 반응은 단순히 적응 과정 때문일 수있다. 그러나 "당신은 다른 현상에 대한이 전체 전화 책을 얻을 수 있습니다."De Lange가 말했습니다.

반면에 예측 처리는 한 번에 많은 현상을 설명하는 통일 프레임 워크를 제공하므로 뇌가 어떻게 작동하는지에 대한 이론으로서의 매력을 제공합니다. Richards는“이 시점의 증거는 매우 설득력이 있다고 생각합니다. "실제로 그 주장에 많은 돈을 기꺼이 넣을 의향이 있습니다."